Volti, intelligenza artificiale e pornografia. Le riflessioni su Trevor Paglen di Luca Arnaudo

Intelligenza artificiale e sorveglianza sono i due poli fra i quali si muovono le riflessioni di Luca Arnaudo attorno alla mostra di Trevor Paglen e Kate Crawford all’Osservatorio della Fondazione Prada di Milano.

Anni fa, un amico mi regalò un esile saggio-intervista di Emmanuel Lévinas, Violenza del volto. Il titolo, e una frammentata costellazione di pensieri di quel grande filosofo etico, mi sono tornati in mente mentre passeggiavo per le sale sontuosamente minimali dell’Osservatorio, lo spazio della Fondazione Prada in Galleria Vittorio Emanuele II a Milano, dove è in corso Training Humans, una mostra dell’artista Trevor Paglen e della ricercatrice Kate Crawford.

DISTOPIE DA MARK LOMBARDI A TREVOR PAGLEN

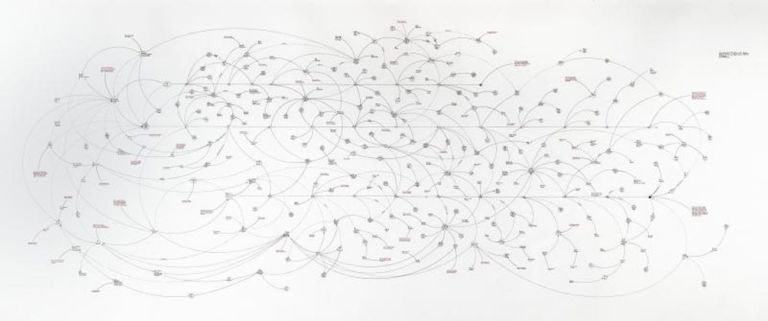

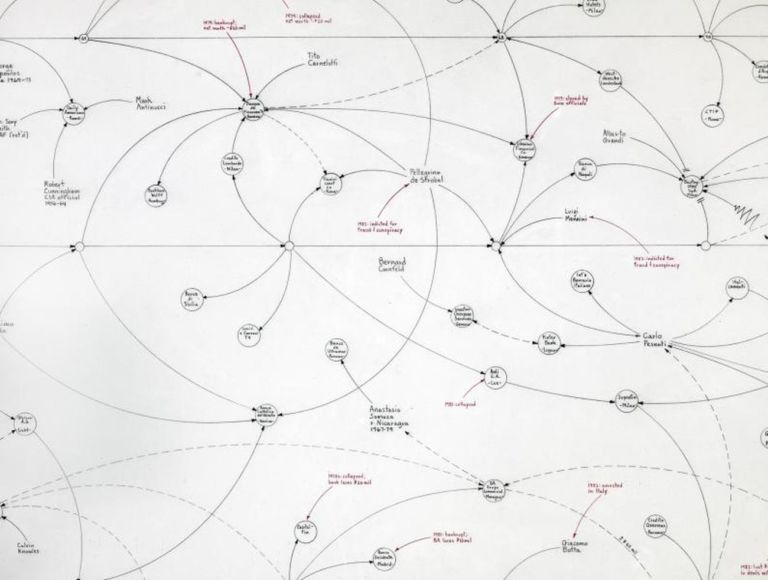

Considero Paglen un artista straordinario, l’unico tra gli emersi che sia stato in grado di riprendere e sviluppare appieno il filo del discorso avviato da Mark Lombardi su una information art volta a indagare ed evidenziare i rapporti di potere e dominio nella storia recente. Dal punto in cui le mappe disegnate di Lombardi si arrestavano per ragioni biografiche – il suicidio dell’artista, probabilmente assai assistito, pochi mesi prima dell’11 settembre 2001 – Paglen è infatti ripartito con analitica fantasia, mettendo a frutto la sua formazione di geografo e fotografo per interrogare, quindi mostrare, rilevanti dispositivi contemporanei di intelligence.

Dopo varie ricostruzioni puntigliose, ottenute sempre con astuta artigianalità, di identità fittizie, affari illeciti, linee di comunicazione sottomarine, messa per il momento da parte la realizzazione di satelliti “disfunzionali” e libri d’artista dedicati a storie segrete dell’aeronautica, Paglen si è dato da ultimo a studiare i percorsi di condizionamento che, passando per la miniera informativa messa gratuitamente a disposizione online da schiere di volenterose e noncuranti cavie, stanno disegnando i prossimi rapporti di dominio incentrati sui servizi dell’intelligenza artificiale.

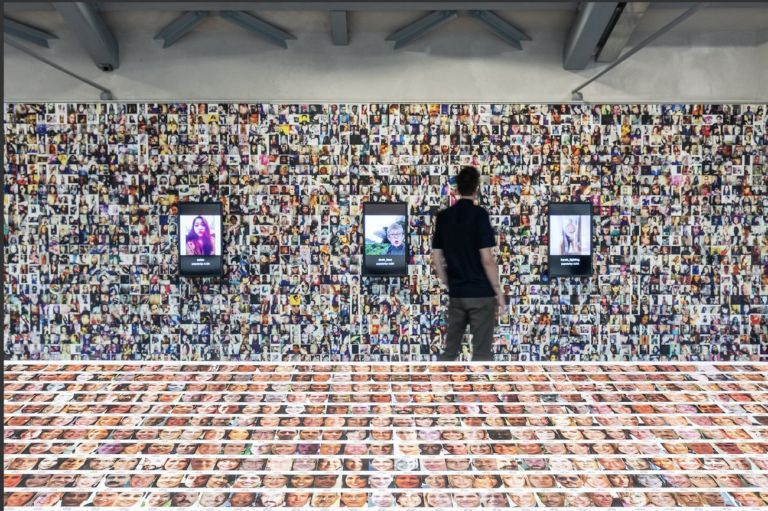

Training Humans. Exhibition view at Osservatorio Fondazione Prada, Milano 2019. Photo Marco Cappelletti

LA MOSTRA DI MILANO

La mostra milanese, espansione di un nucleo già mostrato nell’edizione palermitana di Manifesta, è un esempio efficace della ricerca appena richiamata, svolta in collaborazione con una nota esperta della materia (Kate Crawford è, fra l’altro, la fondatrice dell’AI Now Institute presso la New York University), vertendo su alcuni esempi eclatanti dei percorsi di allenamento visivo-cognitivo per il riconoscimento biometrico sin qui impiegati da laboratori di ricerca e imprese – soprattutto statunitensi e cinesi – per l’addestramento dell’AI.

Un numero sempre crescente di immagini di volti, fotografati di proposito o più semplicemente estratti dalla miniera delle reti internet, alimenta da tempo i software di riconoscimento perché imparino a stabilire cosa sia umano e cosa aspettarsi da esso, in linea di massima per orientarlo o prevenirlo.

A partire da tale snodo evolutivo dell’AI, Paglen & Crawford hanno selezionato una serie di test di allenamento reperibili liberamente – a ulteriore conferma, se mai ancora servisse, che nella cosiddetta età dell’informazione l’accessibilità a essa non ne garantisce affatto una conoscenza – e li hanno esposti al pubblico, perlopiù tramite un allestimento a parete e a banco, con un approccio tra lo storiografico e l’anatomo-patologico.

VIOLENZA DEI VOLTI E PORNOGRAFIA

Sfiliamo, dunque, dinanzi a migliaia di volti, talvolta incrociandone lo sguardo. Ed è propriamente in quei momenti inattesi d’incontro che un sentimento sottile di violenza s’impadronisce del pensiero, combinato a un’inquieta impressione di pornografia. Assuefatti come siamo al diluvio immaginale che ci circonda e, in esso, all’esposizione fotografica della nudità, tendiamo in effetti a sottovalutare ormai l’intensità delle sue componenti, orientati per di più dalla comune programmazione culturale del senso del pudore per cui certe parti soltanto dovrebbero suscitare imbarazzo. Soprattutto, è solitamente difficile arrestarci per rilevare quanto definitiva sia per il nostro vissuto l’esposizione a un volto, un singolo volto: quel volto dell’altro, a cui si riferiva Lévinas, per negarne una mera carica fenomenica e sostenerne invece una epifanica, che apre a una dimensione etica della relazione.

Dinanzi alla selezione in mostra, solo a pensare all’uso indotto che di tali effigi è stato fatto, il senso del pornografico emerge disturbante: del resto, l’intento espositivo è proprio quello di portarci a considerare le scelte operate da relazioni di potere rispetto a cosa vada riconosciuto dell’umano a partire dai nostri volti (letteralmente nostri: non a caso un avvertimento nel foglio esplicativo fa presente che, per quanto statisticamente improbabile, una nostra immagine tratta da Internet potrebbe anche trovarsi nei database esposti).

Conseguenza inattesa di una simile esperienza, per me, è stato l’aggiornamento della vecchia battuta del giudice della Corte Suprema USA Potter Stewart, dal dibattimento del caso Jacobellis v. Ohio, secondo cui non sappiamo definire cosa sia pornografico, ma lo riconosciamo quando lo vediamo (“I know it when I see it”). Pornografico, in effetti, è l’esercizio di un rapporto di dominio sull’immagine di un essere umano, una relazione di violenza sull’altro, a partire dall’esposizione del suo corpo lasciato privo di difese: è propriamente quello che sta alla base di quanto ormai da decenni avviene per addestrare le AI – e più in generale, viene da aggiungere, nell’uso non autorizzato di quelle peculiari immagini di noi che sono i nostri dati.

Trevor Paglen, They Watch the Moon, 2010

BIAS DEI TAG

Chi scorra l’intervista di Paglen & Crawford contenuta nel quaderno della mostra troverà anche una serie di riflessioni degli autori sui pregiudizi che condizionano le classificazioni perlopiù artificiosamente binarie assegnate dai programmatori a tali immagini, col rischio che si sviluppino così AI razziste, sessiste, classiste. Si tratta di un contributo interessante ma non particolarmente nuovo, vista la mole di ricerche accademiche già dedicate ai bias nelle applicazioni basate su big data (per un approccio pop, si può ricorrere al libro di Kathy O’Neil, Armi di distruzione matematica. Come i big data aumentano la disuguaglianza e minacciano la democrazia).

Anche questo necessario promemoria sulle nostre responsabilità di programmatori del mondo, ad ogni buon conto, possiamo ascrivere a merito della mostra visitata, salvo metterlo da parte con vago sconforto mentre, lasciato l’Osservatorio, cerchiamo di non pensare alle telecamere che, ovunque presenti, osservano il nostro inoltrarci nella folla dello shopping in galleria, possibilmente seguendo il nostro volto.

‒ Luca Arnaudo

1 / 8

1 / 8

2 / 8

2 / 8

3 / 8

3 / 8

4 / 8

4 / 8

5 / 8

5 / 8

6 / 8

6 / 8

7 / 8

7 / 8

8 / 8

8 / 8

Artribune è anche su Whatsapp. È sufficiente cliccare qui per iscriversi al canale ed essere sempre aggiornati