Google ha messo a punto un algoritmo che imita il lavoro dei fotografi. Ecco le immagini

Siamo ancora in grado di distinguere un'immagine fotografica scattata dall'uomo da una realizzata dal computer? A quanto pare questa attività in futuro sarà sempre più difficile. Ecco le immagini prodotte da Creatism, la rete neurale “creativa” di Google.

L’intelligenza artificiale è un settore in grandissimo fermento. Nonostante i timori degli scettici e le narrazioni distopiche che ci mettono in guardia dai pericoli di un futuro dominato dalle macchine, la ricerca sulla potenza dei processi algoritmici non conosce battute di arresto. I computer, grazie ad appositi programmi di training messi a punto dall’uomo, stanno imparando a vedere, a riconoscere e descrivere ciò che vedono, a guidare la macchina nel traffico, a giocare in borsa e a rispondere al telefono. Non mancano però anche le applicazioni di tipo creativo: ci sono software in grado di comporre musica, scrivere poesie, creare immagini ex novo, persino emulare lo stile di artisti famosi.

UN SISTEMA PER LA CREAZIONE DI CONTENUTI ARTISTICI

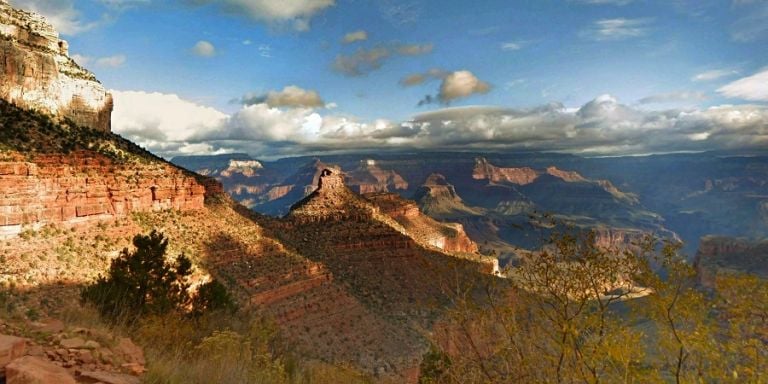

Giusto qualche settimana fa, i ricercatori di Google Hui Fang e Meng Zhang hanno pubblicato uno studio che descrive le funzionalità di un nuovo network neurale chiamato Creatism, ovvero “un sistema per la creazione di contenuti artistici”. L’idea alla base del progetto è di insegnare al computer a generare scatti originali, e per farlo i due studiosi hanno dovuto prima di tutto isolare i parametri principali su cui si basa l’estetica fotografica (saturazione dell’immagine, composizione, inquadratura, messa a fuoco etc.). Successivamente, hanno dato in pasto al programma 1500 foto artistiche professionali estratte dal sito 500px.com, un database da cui imparare e “trarre ispirazione”. Come risultato, l’algoritmo è diventato in grado di “emulare il flusso di lavoro di un fotografo di paesaggio, dalla ricerca della migliore inquadratura agli interventi di postproduzione”. A questo punto, la rete neurale ha iniziato a “scattare” le prime fotografie usando come soggetto dei panorami di Google Street View che ritraggono alcune location molto scenografiche come il Gran Canyon, Bis Sur e il parco di Yellowstone.

IL TURING TEST FINALE

Per valutare il successo dell’operazione, Fang e Zhang hanno poi attuato una sorta di Turing Test chiedendo a sei fotografi professionisti di valutare le immagini senza metterli al corrente del genere “particolare” del loro autore. Incredibili i risultati: su 173 immagini il 41% è stato giudicato di livello semi-professionale o professionale, e il 13% anche di livello superiore. Il corrispondente test di controllo effettuato con vere fotografie ha ottenuto risultati migliori ma non di molto. Insomma, il computer ancora non ha raggiunto un livello comparabile a quello umano, ma ci è andato pericolosamente vicino…

– Valentina Tanni

https://google.github.io/creatism

Artribune è anche su Whatsapp. È sufficiente cliccare qui per iscriversi al canale ed essere sempre aggiornati